728x90

반응형

SMALL

손실 함수 J 의 경사(Gradient)가 작아지는 방향으로 업데이트 하면 손실 함수의 값을 줄일 수 있음

매 Iteration 마다 해당 가중치에서의 비용 함수의 도함수(=비용 함수를 미분한 함수)를 계산하여 경사가 작아질 수 있도록 가중치 변경

기울기 반대 방향으로

배 만큼 이동

각각의 가중치는 역전파의 주요 메커니즘인 편미분과 Chain Rule(연쇄 법칙)이 사용

특정 가중치에 대한 기울기는 손실 함수를 해당 가중치로 편미분

모든 가중치에 대한 값은 Chain Rule로 구함

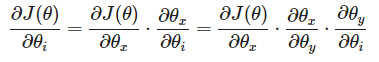

연쇄 법칙이란 특정 변수에 대한 (편)미분 값을 다른 변수의 미분을 사용하여 나타낼 수 있는 방식

연쇄 법칙을 사용하여 각 변수가 얼마나 수정되어야 할 지에 대한 정보를 전달

728x90

반응형

LIST

'IT' 카테고리의 다른 글

| 배치 사이즈(Batch Size) (0) | 2022.06.05 |

|---|---|

| 옵티마이저(Optimizer) (0) | 2022.06.04 |

| 신경망 학습(Training Neural Network) (0) | 2022.06.02 |

| 기울기 소실 (0) | 2022.06.01 |

| 활성화 함수(Activation Function)의 공통점 (0) | 2022.05.31 |